2026年2月13日

我们一度也为此兴奋,甚至焦虑。

过去一年,行业里不断出现这样的声音:“一键生成电影级大片”“AI已能替代专业后期”。资本市场为之沸腾,用户蜂拥而至,生成物的流畅度在以肉眼可见的速度爬升。半年前还随处可见的扭曲人脸、六指畸形,如今在主流模型上已大幅减少。

但我们也越来越不确定:生成,真的等于交付吗?

一、概率机的宿命

如果你和我们一样,恰好做过音视频底层技术的工程交付,恰好读过那些公开的模型技术报告,你会注意到一个事实:

所有主流视频生成大模型——无论是OpenAI Sora、快手可灵、字节跳动的Seedance系列,还是智源Emu3——其骨干网络均为Transformer架构。

这不是推测。Sora的技术报告写明了Diffusion Transformer(DiT);可灵的论文写明了3D VAE+DiT;Emu3的论文写明了纯Transformer自回归路线。而Seedance系列作为字节跳动的消费级主力产品,业界普遍认为其底层同样遵循Transformer/DiT技术路线。

两条路径殊途同归:视频的每一帧、每一个像素、每一段运动轨迹,本质上都是对“下一个词元”的概率预测。

这不是架构的缺陷,这是它的底层命运。Transformer生来擅长从海量数据中习得“像什么”,却从未被设计去判断“对不对”。它可以在无数次试错中无限逼近真实分布,但它不知道自己什么时候逼近了、什么时候偏航了。

所以“六指猫”从来不是根本问题——它会自然被算力填平。但随着生成物越来越“像人做的”,另一个问题反而变得更尖锐了:

当画面足够流畅、人物不再畸形,用户交付给客户的、呈现给家人的、放进作品集里的——上面带着谁的署名?谁又为它负责?

二、生成是能力,交付是责任

一个技术上的事实常常被热闹掩盖:生成模型的能力边界,不等于产品的交付边界。

一份错把10克盐写成100克的食谱,模型生成只需2秒,但用户按它做菜,晚饭就毁了。一段误判用户情绪状态的人格分析,模型生成只需1秒,但用户读到它,可能几天睡不好觉。

AI的犯错率也许只有5%。但对吃到那顿饭、读到那份报告的具体用户来说,犯错率是100%。

所以我们从一开始就选择了不同的产品路径。

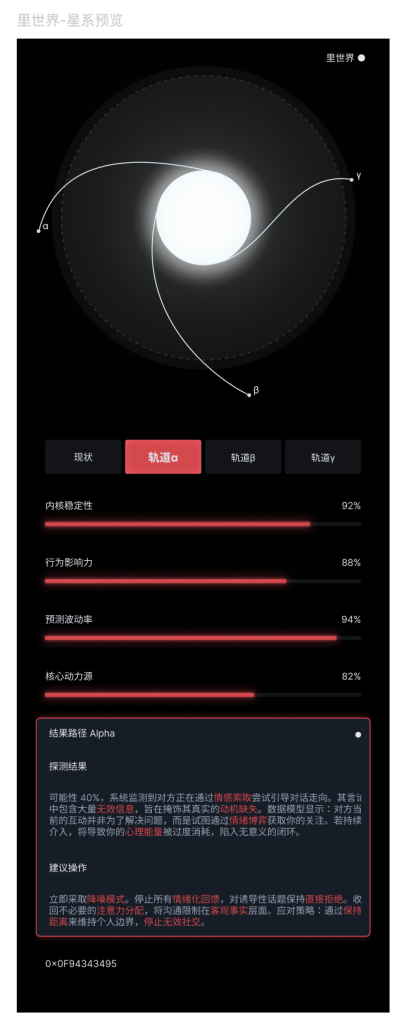

Reborn 不输出“你的人格画像”,它输出需要用户修正、确认、驳回的参考框架。 星系引擎负责解构复杂性,提供演化路径模拟,但最终校准的权利——以及校准的责任——我们留在用户手里。

Lyker 不提供“一键食谱”,它提供需要人工校验的半成品配给方案。 生理稳态算法给出绝对确定的摄入建议,但“今天想吃点别的”——这个判断,我们交给用户自己做。

从产品形态上看,我们做“重”了。多了交互环节,多了修改流程,多了用户的学习成本。展示 PPT 时,经常有朋友问:“你们为什么不做全自动?一键生成多性感。”

我们回答:因为生成不等于交付。

三、不是技术不能,是资本不愿

有人会说:你这是苛责。技术本来就需要工程迭代,难道非要等完美了才发布?

对,也不对。

对的是:工程迭代是技术产业化的必经之路,没有任何模型是实验室直接一步到位的。

不对的是:当前阶段的迭代,被一种特定的商业逻辑锁定了——几乎所有资源都涌向“让生成物更真实”,而不是“让生成物更可靠”。

不是做不到,是不值得做。因为在资本的估值模型里,“震撼”比“可靠”更容易兑现。一段能发朋友圈的15秒流畅视频,其融资价值远高于一套需要用户参与校验、但永远不会出错的交付系统。

这不是技术瓶颈,这是投入产出比的主动选择。

我们理解这套逻辑,它自有它的合理性。我们只是选择了另一条路。

四、这条路我们走了一年零三个月

从公司成立的第一天起,“校验”就被写进产品架构的底层。

我们不相信“模型再大一点、数据再多一点,人类就可以彻底离场”。我们相信另一种未来:AI负责把模糊的意图快速具象为可操作的原型,人类负责在这些原型中辨认出属于自己的那个正确答案。

这不是对技术的不信任,恰恰是对技术的尊重——只有承认概率机的本质,才能设计出真正可靠的人机协作流程。

这条路当然更难。

在用户认知里,“需要我修改”容易被误解成“产品不够智能”。在竞对速度面前,我们花在交互设计、校验机制、反馈闭环上的时间,足够别人迭代三个版本。在资本叙事里,“部分自动化”远不如“完全替代”性感。

但我们还是选择这样做。因为,我们相信真正的乐趣在于创造。

当用户被“一键生成”坑过十次、二十次之后,他们会开始追问:这个东西可靠吗?谁来为错误负责?我能相信它吗?

到那时,所有靠过度承诺换来的日活都会反噬,而真正把用户判断力当作核心资产来尊重的产品,会留下来。

五、写在最后:关于“深度清醒”

公司的官网上写着“为全球0.1%的深度清醒者服务”。这句话是真心的,但它也很容易被读成一种宣言式的骄傲——好像我们在岸上,别人在水里。

不是的。

我们也曾追过“一键生成”的风,也曾在PPT里写过“颠覆”“重构”这些如今看来心虚的词。今天的清醒,一部分来自犯错之后的复盘,另一部分,仅仅是选择不同。

我们选择了一条更重、更慢、更稳的路。这不代表别人走错了,只代表我们找到了自己相信的方式。

它未必正确,但至少诚实。

我们需要为生成负责,而不是为生成辩护。

这是我们对 AI 创作时代的回答。

——不生产幻觉,只交付责任。